Euroopan unionin tekoälyasetus (Artificial Intelligence Act, AI Act) on maailman ensimmäinen kattava tekoälyä koskeva lainsäädäntökokonaisuus. Tämä asetus astui voimaan 1. elokuuta 2024 ja alkaa vaikuttaa vaiheittain. Asetuksen tavoitteena on varmistaa, että tekoälyjärjestelmät ovat turvallisia, eettisiä ja perusoikeuksia kunnioittavia.

Suriya / Adobe Stock (Laurean Education-lisenssi)

Suriya / Adobe Stock (Laurean Education-lisenssi)

Tekoäly kattaa monenlaisia muotoja, jotka voidaan jakaa ohjelmistopohjaisiin ja fyysisiin järjestelmiin. Ohjelmistopohjainen tekoäly sisältää virtuaaliset avustajat, kuvia analysoivat ohjelmistot, hakukoneet sekä puheen- ja kasvojentunnistusjärjestelmät. Fyysiset eli ”ruumiillistetut” tekoälyjärjestelmät taas sisältävät robotit, itseohjautuvat autot, droonit ja asioiden internetiin liittyvät laitteet. Näiden muotojen valvontaan on kehitetty tekoälyasetus (AI Act), joka varmistaa tulevaisuudessa tekoälyn turvallisen ja vastuullisen käytön (Regulation (EU) 2024/1689).

Laurea-ammattikorkeakoulu on yhdessä Humanistisen ammattikorkeakoulun (Humak) kanssa toteuttamassa SaavutaÄly-hanketta, jossa kohderyhmänä ovat kolmannen sektorin organisaatiot ja niiden työntekijät. SaavutaÄly-hankkeen tavoitteina on parantaa osallistujien tekoälyosaamista ja valmiuksia hyödyntää tekoälyä oman työn ja organisaation kehittämisessä sekä saavutettavuutta digitaalisissa palveluissa.

EU:n tekoälyasetus

Tekoälyasetus (AI Act) on maailmanlaajuisesti ensimmäinen kokonaisvaltainen asetus, joka käsittelee tekoälyjärjestelmien riskejä ja asettaa Euroopan johtavaan asemaan tekoälyn sääntelyn alueella. Se tuo tullessaan selkeät vaatimukset ja velvoitteet tekoälyn kehittäjille ja käyttäjille, erityisesti sen suhteen, miten tekoälyä käytetään eri yhteyksissä. Samalla asetus pyrkii vähentämään yritysten, erityisesti pienten ja keskikokoisten, hallinnollista ja taloudellista taakkaa.

EU:n AI Act on merkittävä askel kohti tekoälyn vastuullista kehitystä ja turvallista käyttöä Euroopassa. Säädöksen tavoitteena on edistää luotettavan tekoälyn kehitystä Euroopassa ja sen ulkopuolella varmistamalla, että tekoälyjärjestelmät kunnioittavat perusoikeuksia, turvallisuutta ja eettisiä periaatteita. Säädöksen tavoitteena on ottaa huomioon tekoälyn potentiaaliset riskit, erityisesti voimakkaiden ja vaikutusvaltaisten tekoälymallien osalta. (Regulation (EU) 2024/1689.)

EU:n AI Actin soveltaminen alkaa vaiheittain. Asetus pannaan täytäntöön vaiheittain eri siirtymäaikojen mukaisesti ja se sisältää eri määräaikoja jäsenvaltioille. Mm. perusoikeuksia suojelevien viranomaisten nimeämisen tulee tapahtua kolme kuukautta ja toimivaltaisten viranomaisten nimeämisen 12 kuukautta asetuksen voimaantulosta. Ellei muuta ole säädetty, asetuksen soveltaminen alkaa 24 kuukautta voimaantulon jälkeen. Jäsenvaltioiden on nimettävä kansalliset viranomaiset ja säädettävä seuraamuksista asetuksen rikkomisesta. Suomessa AI Actin täytäntöönpano edellyttää kansallisten valvontaelinten perustamista sekä tekoälymallien testaamiseen sopivien ympäristöjen kehittämistä. Tällä hetkellä tekoälyasetuksen valmisteluvastuu Suomessa on eri ministeriöillä. Suomessa työryhmän tehtäviin kuuluu myös mm. tekoälyn sääntelyn testiympäristöt (ns. hiekkalaatikot). (Työ-ja elinkeinoministeriö 2024).

Riskiperustainen lähestymistapa

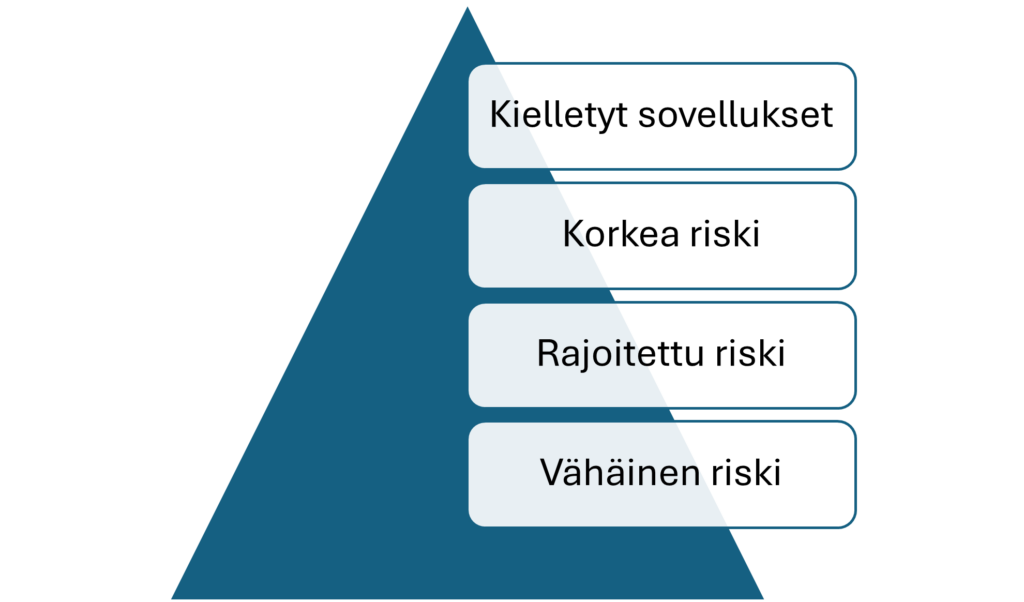

EU:n tekoälysäädöksen päätavoitteena on edistää tekoälyn vastuullista kehittämistä ja käyttöönottoa. Tämä tarkoittaa sitä, että tekoälyjärjestelmät on suunniteltava läpinäkyviksi, jäljitettäviksi, syrjimättömiksi ja ympäristöystävällisiksi. Sääntelyssä sovelletaan riskiperusteista lähestymistapaa, joka jakaa tekoälyjärjestelmät neljään kategoriaan riskitason mukaan (kuvio 1). (Euroopan komissio 2024.)

Kuva 1: Riskiperustainen lähestymistapa (Kärpänen 2025)

Kuva 1: Riskiperustainen lähestymistapa (Kärpänen 2025)

Riskiperustaisessa lähestymistavassa ensimmäisenä ovat kielletyt sovellukset, jotka aiheuttavat hyväksymättömän riskin, kuten ihmisten käyttäytymisen manipuloinnin tai reaaliaikaisen biometrisen tunnistuksen julkisilla paikoilla ilman valvontaa (Euroopan komissio 2024).

Toisena ovat korkean riskin sovellukset, jotka vaikuttavat merkittävästi perusoikeuksiin, kuten terveydenhuollossa, koulutuksessa, rekrytoinnissa ja lainvalvonnassa käytettävät tekoälyjärjestelmät. Tällaisia voivat olla esimerkiksi tekoälysovellukset tai -teknologiat, joita käytetään tenttien pisteytyksiin. Näille asetetaan tiukat vaatimukset, kuten laadunvalvonta, läpinäkyvyys ja ihmisen valvonta. (Euroopan komissio 2024.)

Kolmantena ovat rajoitetun riskin sovellukset, joille asetetaan läpinäkyvyysvelvoitteita, jotta käyttäjät tietävät vuorovaikutuksestaan tekoälyn kanssa. Esimerkkinä tästä voisi olla chatbot, jossa ihminen on vuorovaikutuksessa tekoälyn kanssa. Palvelun tarjoajien on myös varmistettava, että tekoälyn tuottama sisältö on tunnistettavissa. (Euroopan komissio 2024.)

Neljäntenä ovat vähäriskiset sovellukset, joihin suurin osa tekoälyjärjestelmistä kuuluu, eikä näille ole asetettu erityisiä sääntelyvaatimuksia. Tällaisia voivat olla esimerkiksi tekoälyä tukevat roskapostisuodattimet (Euroopan komissio 2024).

Tekoälyn sääntelyllä varmistetaan, että eurooppalaiset voivat luottaa tekoälyn tarjoamiin ratkaisuihin ja kaikki riskejä aiheuttavat tekoälyjärjestelmät, käsitellään asianmukaisesti. Vaikka suurin osa tekoälyjärjestelmistä aiheuttaa vain vähäisiä riskejä, jotkut järjestelmät voivat luoda riskejä, jotka on käsiteltävä, jotta vältetään ei-toivotut seuraukset.

EU:n tekoälyasetus tuo merkittäviä muutoksia myös kolmannelle sektorille, jossa organisaatioiden ja niiden työntekijöiden on sopeuduttava uusiin sääntöihin ja vaatimuksiin. Kolmannen sektorin toimijat voivat hyödyntää tekoälyä monin tavoin, mutta lainsäädännön myötä he joutuvat tarkastelemaan erityisesti tekoälyn käyttöön liittyviä riskejä, kuten eettisyyttä ja perusoikeuksien kunnioittamista. SaavutaÄly-hanke auttaa näitä organisaatioita ja työntekijöitä parantamaan tekoälyosaamistaan, jotta he pystyvät hyödyntämään tekoälyä vastuullisesti ja lainsäädännön mukaisesti mm. tunnistamalla ja testaamalla tekoälyn soveltamismahdollisuuksia organisaatioiden toiminnassa. Hankkeen tavoitteena on lisätä tietoisuutta tekoälyn sääntelystä ja tukea digitaalisten palveluiden saavutettavuutta, mikä parantaa organisaatioiden valmiuksia noudattaa AI Actin vaatimuksia ja kehittää luotettavaa tekoälyä omassa työssään.

Lyhyesti tulevasta hankkeesta, jossa kirjoittaja toimii mm. data- ja tekoälyasiantuntijana:

SaavutaÄly – Tekoälyosaaminen järjestöjen tukena muutoksessa -hankkeen päätavoitteena on parantaa osallistujien tekoälyosaamista ja valmiuksia hyödyntää tekoälyä oman työn ja organisaation kehittämisessä. Hanke on suunnattu kolmannen sektorin organisaatioille ja niiden työntekijöille sekä vapaaehtoisille. Hanke pyrkii tunnistamaan ja vastaamaan työelämän muutoksista johtuviin osaamistarpeisiin tulevaisuusorientoituneesti, tukien osaltaan osallistujien muutoskyvykkyyttä, toimintojen uudistamista sekä kestävämpiä työuria. Lisäksi hankkeessa kehitetään organisaatioiden toimintaa kokeilullisesti tekoälyä hyödyntäen, jotta löydettäisiin uusia ratkaisuja arjen työhön ja parannettaisiin saavutettavuutta. Hanke on Hämeen ELY-keskuksen rahoittama ESR-rahoitteinen hanke, joka toimii ajalla 1.11.2024-31.10.2026 Uudenmaan alueella. Toteuttajina Laurea-ammattikorkeakoulu ja Humanistinen ammattikorkeakoulu.

Lähteet

Tämän artikkelin ensimmäinen kuva (nostokuva) ei ole CC BY-SA -lisensoitu. Sitä on käytetty Adobe Stockin Education-lisenssin ehtojen mukaisesti, eikä sitä saa käyttää edelleen ilman erillistä lupaa.